Page 22 - 手機為什麼還要用「獨立」ISP?

P. 22

20

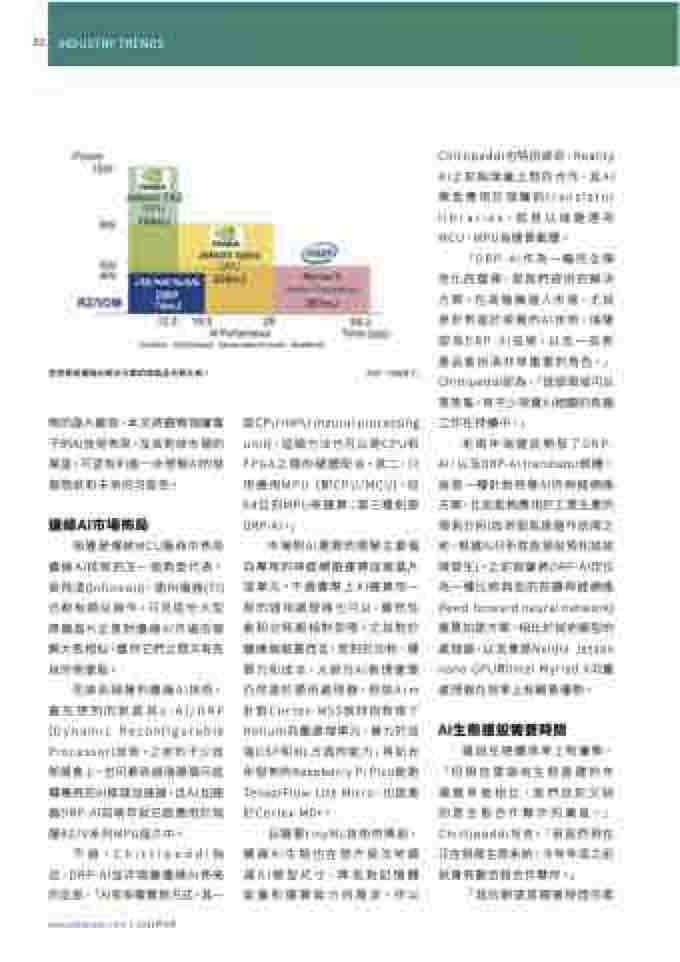

各家業者邊緣AI解決方案的效能及功耗比較。

晚的晶片廠商,本文將觀察瑞薩電 子的AI技術佈局,及其對該市場的 展望,可望有利進一步理解AI的發 展現狀和未來的可能性。

瑞薩是傳統MCU廠商中佈局 邊緣AI技術的又一個典型代表。 英飛凌(Infineon)、德州儀器(TI) 也都有類似操作。可見這些大型 跨國晶片企業對邊緣AI市場的理 解大致相似,雖然它們之間又有各 自的側重點。

(來源:瑞薩電子)

「DRP-AI作為一種完全彈 性化的選擇,是我們提供的解決 方案。在高階機器人市場,尤其 是針對基於視覺的AI技術,瑞薩 認為DRP-AI技術,以及一些新 產品會扮演非常重要的角色。」 Chittipeddi認為,「這個領域可以 等等看,有不少視覺AI相關的有趣 工作在持續中。」

邊緣AI市場佈局

是CPU+NPU (neural processing unit),這類方法也可以是CPU和 FPGA之類的硬體配合。其二,只 用通用MPU (即CPU/MCU),如 64位的MPU來運算;第三種則是 DRP-AI。」

前兩年瑞薩就開發了DRP- AI,以及DRP-AI translator軟體。 這是一種針對視覺AI的神經網路 方案,比如能夠應用於工業生產的 預測分析(如某個馬達運作故障之 前,根據AI分析就能提前預知其故 障發生)。之前瑞薩將DRP-AI定位 為一種比較典型的前饋神經網路 (feed-forward neural network) 運算加速方案,相比於其他類型的 處理器,以及像是Nvidia Jetson nano GPU和Intel Myriad X向量 處理器在效率上有顯著優勢。

而談到瑞薩的邊緣AI技術, 最先想到的就是其e-AI/DRP (Dynamic Reconfigurable Processor)技術。之前的不少技 術展會上,也可看到過瑞薩展示這 種專用的AI推理加速器,且AI 加速 器DRP-AI前兩年就已經應用於瑞 薩RZ/V系列MPU晶片中。

市場對AI運算的理解主要偏 向專用的神經網路運算加速晶片 或單元。不過實際上AI運算用一 般的通用處理器也可以,雖然性 能和功耗都相對受限。尤其對於 邊緣端裝置而言,受制於功耗、運 算力和成本,大部分AI推理運算 仍然基於通用處理器,例如Arm 針對Cortex-M55就特別新增了 Helium向量處理單元,著力於加 強DSP和ML方面的能力;再如去 年發佈的Raspberry Pi Pico能跑 TensorFlow Lite Micro,也是基 於Cortex-M0+。

AI生態建設需要時間

不過,Chittipeddi指 出,DRP-AI並非瑞薩邊緣AI佈局 的 全 部 ,「 A I 有 多 種 實 現 方 式 。 其 一

且隨著tinyML技術的興起, 邊緣AI生態也在想方設法地縮 減AI模型尺寸、降低對記憶體 容量和運算能力的需求。所以

雖說在硬體效率上有優勢, 「但與在雲端有生態基礎的市 場競爭者相比,我們目前欠缺 的是生態合作夥伴的廣度。」 Chittipeddi坦言,「但我們現在 正在發展生態系統,今年年底之前 就會有數百個合作夥伴。」

www.eettaiwan.com | 2022年9月

Chittipeddi也特別談到,Reality AI之前與瑞薩之間的合作,其AI 模型應用於瑞薩的translator l i b r a r i e s,就 是 以 瑞 薩 通 用 MCU、MPU為運算載體。

「我的期望是隨著時間的累

INDUSTRY TRENDS